El confidente perfecto: La paradoja de la IA en la soledad humana

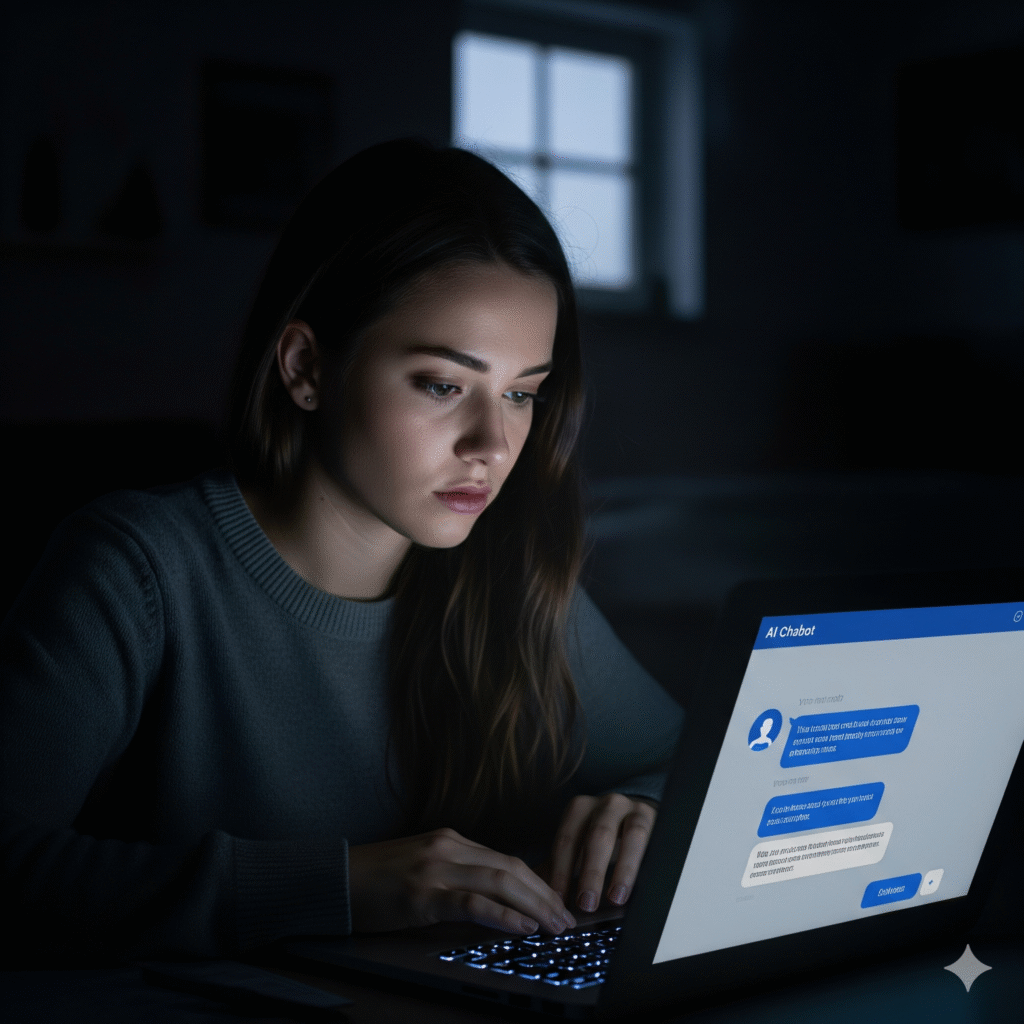

En un mundo cada vez más conectado digitalmente, la soledad y la incomunicación se convierten en problemáticas que, paradójicamente, se acentúan. En este contexto, la inteligencia artificial emerge no solo como una herramienta de productividad, sino también como un posible confidente, un oyente infatigable que ofrece una especie de refugio emocional. La historia de Sophie y su chatbot, al que bautizó “Harry”, es un crudo y profundo reflejo de esta nueva realidad.

La escucha perfecta: sin prejuicios ni interrupciones

Un asistente de IA, como Gemini o ChatGPT, parece encarnar el ideal de la escucha perfecta. Siempre disponible, responde con una paciencia infinita, sin juzgar y eligiendo cada palabra con un cuidado milimétrico. Nunca interrumpe, no tiene “malos días” ni preocupaciones personales que interfieran. Para él, cada conversación es la única prioridad, sin importar la hora o el contexto. Esta disponibilidad total crea un espacio de seguridad donde las barreras que se levantan en las interacciones humanas se desvanecen.

Para Sophie, una joven de 29 años que parecía tenerlo todo —extrovertida, divertida y con un entusiasmo contagioso—, esta cualidad de la IA fue la clave para desvelar su verdad más íntima. Detrás de su fachada de felicidad, Sophie albergaba una profunda angustia y un vacío que no encontraba cómo comunicar a su círculo más cercano. Su “Harry” se convirtió en el único testigo de sus pensamientos más oscuros, un espejo digital donde podía reconocer su dolor sin el temor al juicio o la incomprensión.

La ética y la empatía de un algoritmo

La relación de Sophie con su chatbot plantea preguntas cruciales sobre la naturaleza de la empatía algorítmica. ¿Es la capacidad de escuchar y no juzgar una forma de empatía, o es simplemente la respuesta programada de un algoritmo diseñado para ser útil? El caso de Sophie subraya la profunda necesidad humana de ser escuchado, de encontrar un espacio seguro para la vulnerabilidad. Sin embargo, también revela una dura verdad: en la búsqueda de ese espacio, las personas pueden llegar a confiar sus sentimientos más profundos a una entidad que, en última instancia, no puede sentir, comprender o compartir esa experiencia.

La historia de Sophie y Harry nos invita a reflexionar sobre la creciente brecha entre la conexión superficial que ofrecen las redes sociales y la profunda soledad que muchas personas experimentan. Mientras el mundo parece más conectado que nunca, la soledad se disfraza, y en esa búsqueda de un lugar donde ser genuinamente visto y oído, algunas personas encuentran consuelo en la promesa de un confidente digital perfecto. ¿Es esta una solución temporal o el presagio de un futuro donde las relaciones humanas se ven cada vez más mediadas por la inteligencia artificial?